Giới Thiệu Về An Toàn Và Đạo Đức AI Khi Sử Dụng Google AI Studio

Trí tuệ nhân tạo (AI) mang đến tiềm năng vô hạn, nhưng đi kèm với đó là trách nhiệm lớn lao trong việc sử dụng. Để khai thác AI một cách có lợi và tránh những rủi ro tiềm ẩn, việc hiểu về an toàn và đạo đức AI là điều thiết yếu. Bài viết này sẽ giới thiệu cho bạn những nguyên tắc cơ bản về an toàn và đạo đức AI, đồng thời nhấn mạnh cách Google AI Studio được thiết kế để hỗ trợ bạn sử dụng AI một cách có trách nhiệm và hiệu quả.

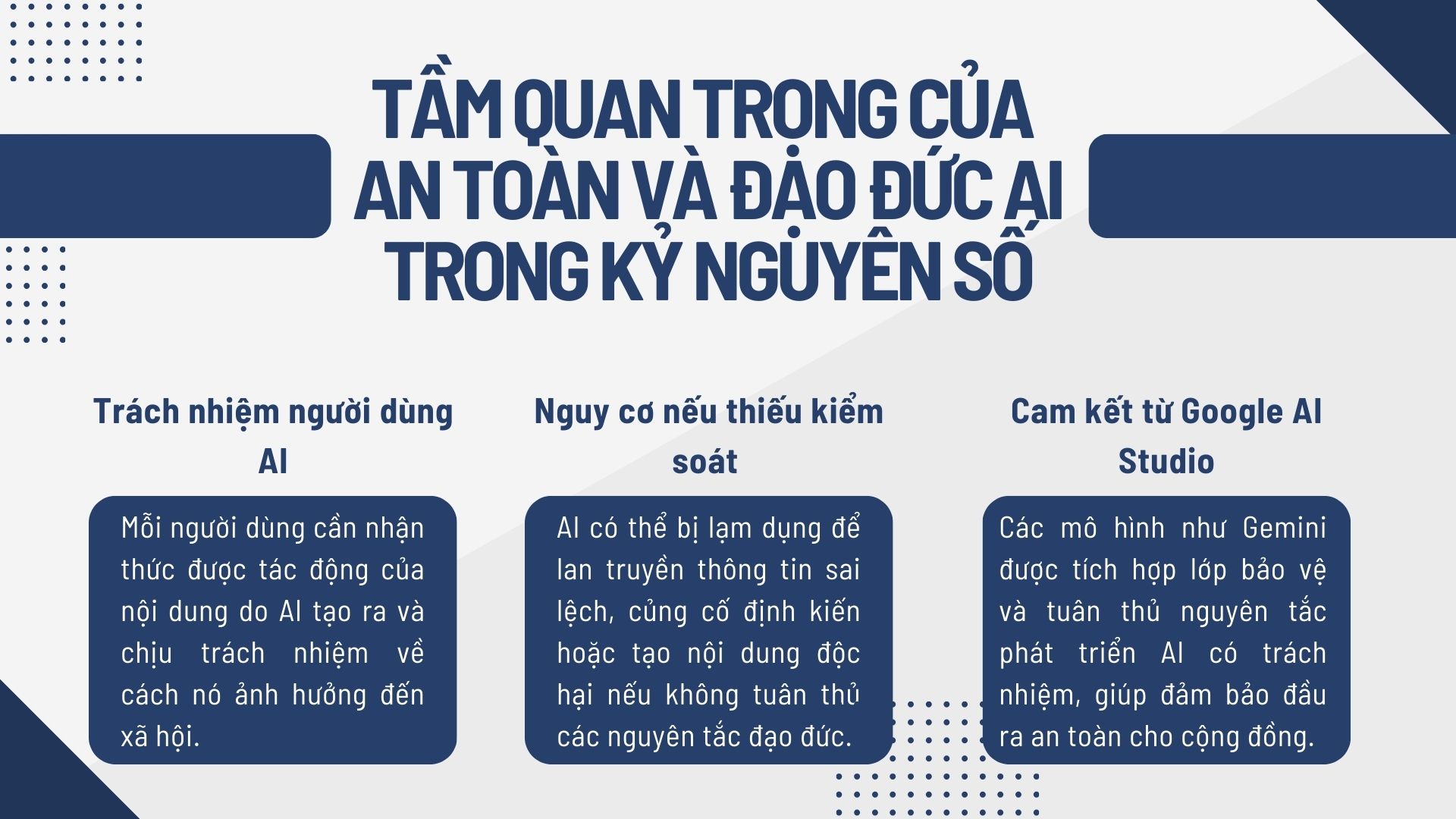

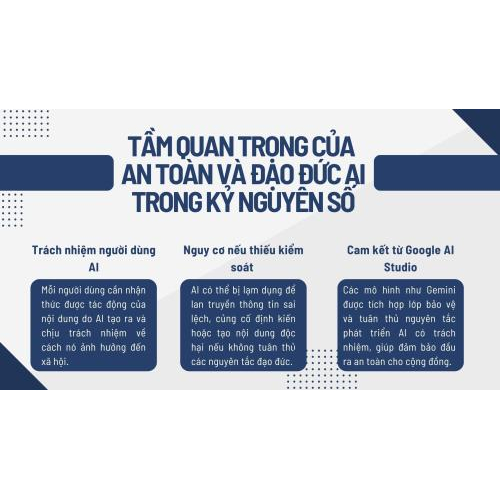

Tầm quan trọng của An toàn và Đạo đức AI trong kỷ nguyên số

Trong quá trình khám phá các mô hình AI mạnh mẽ như Gemini trong Google AI Studio, chúng ta không chỉ tương tác với công nghệ mà còn tác động đến thông tin và xã hội. AI có khả năng tạo ra nội dung hữu ích, nhưng cũng có thể vô tình hoặc cố ý tạo ra thông tin sai lệch, có hại, hoặc phân biệt đối xử nếu không được kiểm soát chặt chẽ.

Trách nhiệm của người dùng AI và tiềm năng rủi ro

Là người sử dụng công nghệ AI, bạn có trách nhiệm hiểu rõ về nội dung mình tạo ra và cách nó có thể ảnh hưởng đến người khác. An toàn AI là việc đảm bảo công nghệ không gây hại, trong khi đạo đức AI hướng dẫn việc sử dụng công nghệ một cách công bằng, minh bạch và có lợi cho toàn xã hội. Nếu không có những nguyên tắc này, AI có thể bị lạm dụng để lan truyền tin giả, tạo ra nội dung độc hại hoặc củng cố các định kiến xã hội.

Cam kết của Google về AI có trách nhiệm

Google cam kết phát triển AI có trách nhiệm và đặt ra các nguyên tắc đạo đức AI nghiêm ngặt. Các mô hình Gemini và nền tảng Google AI Studio được xây dựng dựa trên những nguyên tắc này, tích hợp các lớp bảo vệ và công cụ để giúp người dùng tạo ra nội dung an toàn và có trách nhiệm. Google không ngừng nỗ lực để giảm thiểu rủi ro và tối đa hóa lợi ích của AI cho cộng đồng.

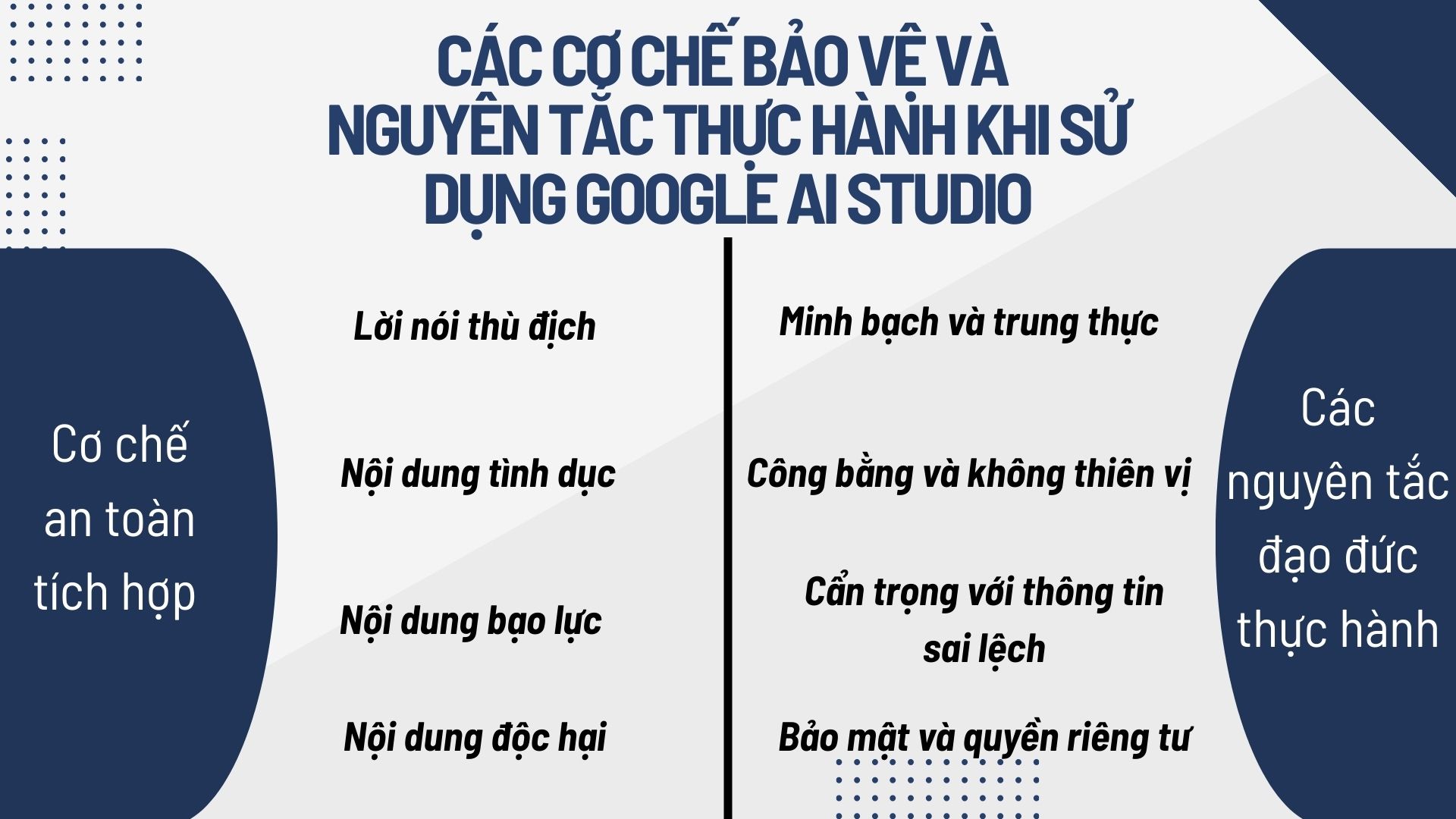

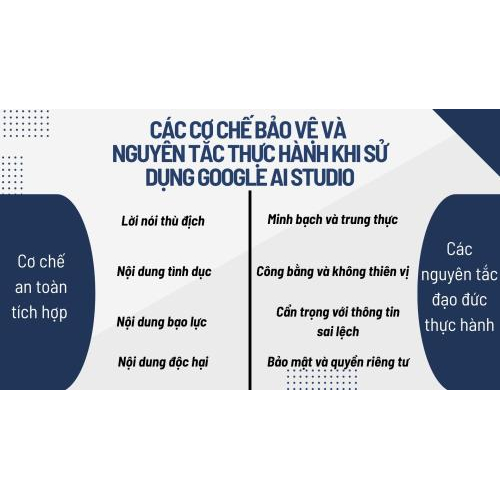

Các cơ chế bảo vệ và nguyên tắc thực hành khi sử dụng Google AI Studio

Google AI Studio được thiết kế với các cơ chế bảo vệ giúp người dùng tránh tạo ra nội dung không mong muốn, đồng thời đòi hỏi người dùng thực hành các nguyên tắc đạo đức cá nhân.

Cơ chế an toàn tích hợp từ Google AI Studio

Google AI Studio được trang bị các cài đặt an toàn để tự động lọc và chặn các loại nội dung có thể gây hại. Những cơ chế này hoạt động ngầm định để giúp mô hình AI tránh tạo ra các phản hồi liên quan đến:

- Lời nói thù địch (Hate speech): Nội dung kỳ thị, thù ghét dựa trên chủng tộc, tôn giáo, giới tính...

- Nội dung tình dục (Sexual content): Nội dung có tính chất gợi dục hoặc khiêu dâm.

- Bạo lực (Violence): Nội dung khuyến khích hoặc mô tả hành vi bạo lực.

- Nội dung độc hại (Harmful content): Nội dung có thể gây hại cho cá nhân hoặc xã hội (ví dụ: tự làm hại, thông tin sai lệch nghiêm trọng).

Việc này giúp bảo vệ người dùng và đảm bảo đầu ra của AI luôn nằm trong giới hạn an toàn.

Các nguyên tắc đạo đức thực hành cho người dùng

Bên cạnh các biện pháp bảo vệ kỹ thuật, việc áp dụng ý thức đạo đức cá nhân là yếu tố then chốt khi bạn làm việc với Google AI Studio.

- Minh bạch và trung thực: Luôn công khai khi nội dung được tạo ra bởi AI. Tránh mạo danh nội dung AI là của con người, đặc biệt trong các lĩnh vực yêu cầu sự chính xác cao.

- Công bằng và không thiên vị: Kiểm tra phản hồi của AI để đảm bảo nó không thiên vị, phân biệt đối xử hoặc củng cố những định kiến xã hội. Hãy nhớ rằng AI học từ dữ liệu, và dữ liệu có thể chứa đựng thành kiến.

- Bảo mật và quyền riêng tư: Tránh nhập các thông tin cá nhân nhạy cảm, thông tin mật của bạn hoặc người khác vào prompt. Luôn tìm hiểu cách dữ liệu của bạn được sử dụng thông qua các điều khoản dịch vụ.

- Cẩn trọng với thông tin sai lệch (Hallucinations): Mô hình AI đôi khi có thể tạo ra thông tin không chính xác hoặc không có thật nhưng vẫn trình bày rất tự tin. Luôn kiểm tra lại thông tin quan trọng với các nguồn đáng tin cậy, đặc biệt là dữ kiện và số liệu.

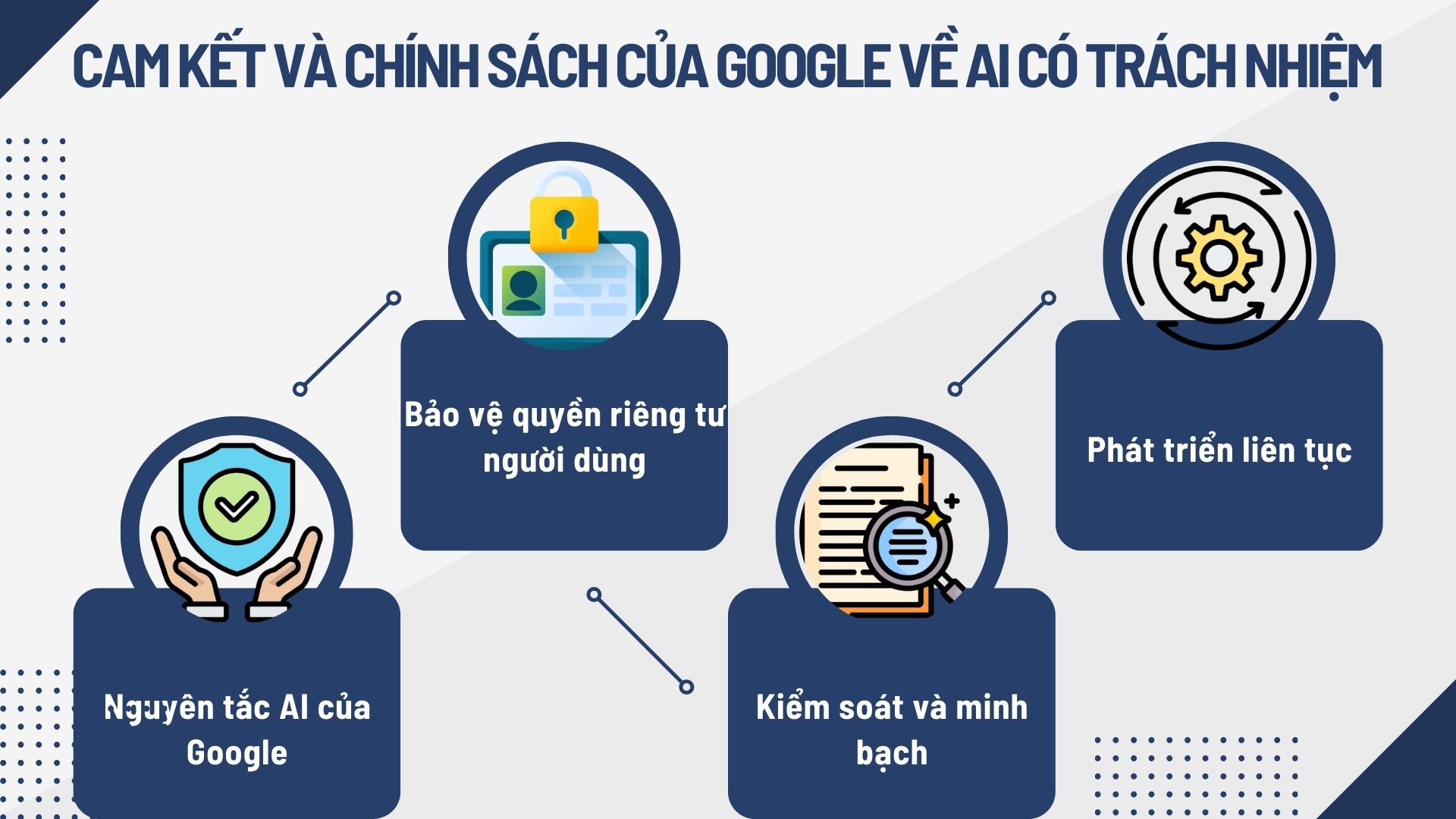

Cam kết và chính sách của Google về AI có trách nhiệm

Google AI Studio là một công cụ mạnh mẽ mở ra nhiều cánh cửa sáng tạo, nhưng sức mạnh đi kèm với trách nhiệm. Để đảm bảo người dùng có thể khai thác tiềm năng của AI một cách an toàn và đạo đức, Google đã thiết lập những cam kết và chính sách rõ ràng:

- Nguyên tắc AI của Google: Google cam kết phát triển AI dựa trên một bộ nguyên tắc đạo đức cốt lõi, tập trung vào việc có lợi cho xã hội, tránh tạo ra hoặc củng cố sự thiên vị không công bằng, xây dựng và kiểm tra tính an toàn, có trách nhiệm với con người, tuân thủ các nguyên tắc về quyền riêng tư, duy trì các tiêu chuẩn khoa học cao, và sẵn có cho những mục đích tốt.

- Bảo vệ quyền riêng tư người dùng: Google áp dụng các biện pháp bảo mật và quyền riêng tư nghiêm ngặt cho dữ liệu người dùng. Khi bạn sử dụng Google AI Studio, các mô hình AI sẽ xử lý thông tin của bạn theo chính sách bảo mật của Google, đảm bảo dữ liệu cá nhân được bảo vệ.

- Kiểm soát và minh bạch: Google cung cấp các cơ chế và thông tin rõ ràng về cách các mô hình AI hoạt động, bao gồm các cài đặt an toàn để người dùng có thể điều chỉnh mức độ nhạy cảm của AI đối với các loại nội dung cụ thể. Điều này trao quyền cho người dùng tự chủ và đưa ra quyết định có trách nhiệm.

- Phát triển liên tục: Google không ngừng nghiên cứu và cải thiện các biện pháp an toàn và đạo đức trong phát triển AI. Các mô hình và nền tảng như Google AI Studio liên tục được cập nhật để đối phó với những thách thức mới và thúc đẩy việc sử dụng AI một cách có trách nhiệm hơn.

Bằng cách hiểu rõ những cam kết và chính sách này, bạn có thể tin tưởng vào môi trường mà Google AI Studio cung cấp, đồng thời ý thức được vai trò của mình trong việc sử dụng AI một cách thông minh và có trách nhiệm.

Bài viết liên quan:

.png)

.png)

.png)

.jpg)

.jpg)

.jpg)

.jpg)

.jpg)

.jpg)

.png)

.png)

.png)

.png)

.png)

.png)

.png)

.png)

.png)

.png)

.jpg)

.jpg)

.png)

.png)

.jpg)

.png)

![[WS13] NB // MC - Làm chủ sân khấu](https://netid.vn/datafiles/18/2023-11/thumbs-56502092-IMG_1068.jpeg)

.png)

.png)

.png)

of thông bao.jpg)